O ônus percebido da IA dificulta a adoção de cuidados de saúde, o estudo encontra

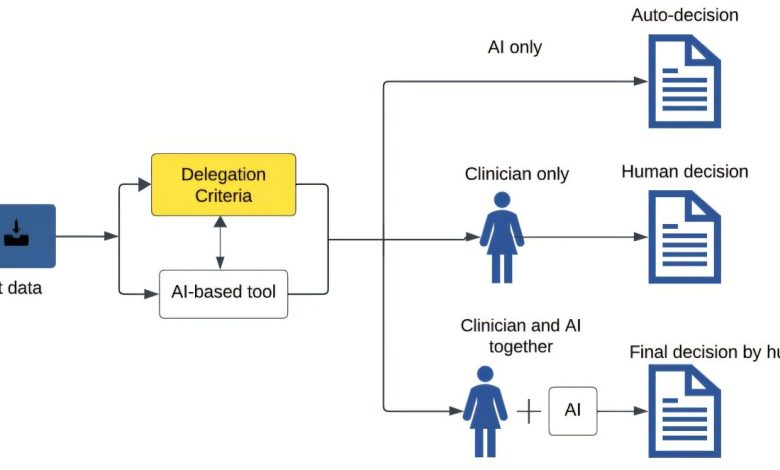

O fluxo de trabalho clínico para uma ferramenta de suporte de decisão autônoma. Crédito: arxiv (2025). Doi: 10.48550/arxiv.2503.18778

Os benefícios potenciais da IA para o atendimento ao paciente podem ser negligenciados se não forem tomadas medidas urgentes para garantir que as tecnologias sejam eficazes para os médicos que os usam, argumenta um novo white paper.

O artigo é publicado no arxiv servidor pré -impressão.

O setor de saúde é uma das maiores áreas de investimento da IA em todo o mundo e está no centro das políticas públicas de muitas nações para sistemas de saúde mais eficientes e responsivos. No início deste ano, o governo do Reino Unido estabeleceu estratégias para “TurboCharge AI” na assistência médica.

O Livro Branco – uma colaboração entre o Centro de Garantir Autonomia da Universidade de York, a Fundação MPS e a Academia de Melhoria organizada no Instituto de Pesquisa em Saúde de Bradford – faz a maior ameaça à aceitação da IA nos cuidados de saúde é o “interruptor off”.

Se os médicos da linha de frente verem a tecnologia como onerosa, inadequada para o propósito ou cautelosos sobre como ela afetará sua tomada de decisão, seus pacientes e suas licenças, é improvável que eles queiram usá-la.

Pia de responsabilidade

Entre as principais preocupações do artigo está que os médicos correm o risco de se tornar “afundar de responsabilidade”-absorvendo toda a responsabilidade legal por decisões influenciadas pela IA, mesmo quando o próprio sistema de IA pode ser falha.

O White Paper baseia -se nos resultados do projeto de pesquisa compartilhado de Caire (Avaliação de Restos da AI), que foi concedido em parceria com o Centro para garantir a autonomia. A pesquisa examinou o impacto de seis ferramentas de apoio à decisão de IA em médicos, reunindo pesquisadores com experiência em segurança, medicina, IA, interação humano-computador, ética e direito.

O professor Ibrahim Habli, do Centro de Autonomia e Segurança da Universidade de York, disse: “Este papel branco oferece aos médicos, que estão na linha de frente do uso dessas tecnologias no NHS e mais amplo setor de saúde, recomendações claras e de concreto sobre o uso de essas ferramentas em segurança.

“A pesquisa da qual essas recomendações foram desenvolvidas envolviam informações de pacientes e médicos e baseiam-se em cenários do mundo real e ferramentas de apoio à decisão de IA quase com futuro, o que significa que elas podem ser aplicadas a situações atuais”.

Autonomia

A equipe avaliou diferentes maneiras pelas quais as ferramentas de IA poderiam ser usadas pelos médicos – distribuindo ferramentas que simplesmente fornecem informações, através daqueles que fazem recomendações diretas aos médicos e àqueles que ligam diretamente com os pacientes.

Clínicos e pacientes incluídos no estudo concordaram em preservar a autonomia do clínico, com os médicos preferindo um modelo de IA que destacava dados clínicos relevantes, como pontuações de risco, sem fornecer recomendações explícitas para decisões de tratamento – demonstrando uma preferência por ferramentas informativas que apoiam em vez de julgamento clínico direto.

O White Paper também destaca que os médicos devem estar totalmente envolvidos no design e desenvolvimento da ferramenta de IA que usarão e que a reforma da responsabilidade do produto pelas ferramentas de IA é necessária, devido a desafios significativos na aplicação do regime atual de responsabilidade do produto.

Burnout

O professor Tom Lawton, consultor em cuidados intensivos e anestésicos nos hospitais de ensino de Bradford, NHS Trust, clínica e líder de IA sobre a Caire compartilhada, disse: “A IA nos cuidados de saúde está passando rapidamente da aspiração para a realidade, e o ritmo puro significa que o risco de terminar as tecnologias que trabalham mais para os desenvolvedores do que os clínicos e pacientes.

“Esse tipo de falha corre o risco de esgotamento do clínico, ineficiências e a perda da voz do paciente-e podem levar à perda de IA como uma força para o bem quando os médicos simplesmente alcançam a troca. Acreditamos que esse papel branco ajudará a resolver esse problema urgente”.

O White Paper fornece sete recomendações para evitar o “desligamento” das ferramentas de IA, mas os autores dizem que o governo, desenvolvedores e reguladores da IA devem considerar todas as recomendações com urgência.

Mudança rápida

A professora Gozie Offiah, presidente da MPS Foundation, disse: “Os cuidados de saúde estão passando por mudanças rápidas, impulsionadas pelos avanços da tecnologia que podem impactar fundamentalmente na prestação de cuidados de saúde. No entanto, existem desafios e riscos reais que devem ser abordados.

A equipe escreveu para os reguladores e o ministro do governo para que eles aceitem a bordo das novas recomendações.

Sete recomendações do white paper:

- As ferramentas de IA devem fornecer aos médicos informações, não recomendações. Com o atual regime de responsabilidade do produto, o peso legal de uma recomendação de IA não é claro. Ao fornecer informações, em vez de recomendações, reduzimos qualquer risco potencial para médicos e pacientes.

- Revise a responsabilidade do produto pelas ferramentas de IA antes de permitir que elas façam recomendações. Existem dificuldades significativas na aplicação do regime atual de responsabilidade do produto a uma ferramenta de IA. Sem reformas, existe o risco de os médicos atuarem como um ‘responsabilidade afundar ”, absorvendo toda a responsabilidade, mesmo onde o sistema é uma das principais causas do erro.

- As empresas de IA devem fornecer aos médicos o treinamento e as informações necessárias para torná -los confortáveis, aceitando a responsabilidade pelo uso de uma ferramenta de IA. Os médicos precisam entender o objetivo pretendido de uma ferramenta de IA, os contextos que foi projetada e validada para desempenhar, e o escopo e as limitações de seu conjunto de dados de treinamento, incluindo potencial viés, a fim de oferecer o melhor atendimento possível aos pacientes.

- As ferramentas de IA não devem ser consideradas como colegas seniores em equipes de clínica-máquina. Como os médicos devem abordar os conflitos de opinião com a IA devem ser explicitados em novas orientações políticas de IA de assistência médica e em orientação das organizações de saúde. Os médicos nem sempre devem concordar ou adiar a recomendação de uma IA da mesma maneira que fariam para um colega sênior.

- A divulgação deve ser uma questão de critério bem informado. Como o clínico é responsável pelo atendimento ao paciente, e esse desacordo com uma ferramenta de IA pode acabar preocupando o paciente, deve estar a critério do clínico, dependendo do contexto, seja divulgado ao paciente que sua decisão foi informada por uma ferramenta de IA.

- As ferramentas de IA que funcionam para os usuários precisam ser projetadas com usuários. No setor de saúde crítico e rápido, envolvendo os médicos no design de todos os aspectos de uma ferramenta de IA-da interface, ao equilíbrio de informações fornecidas, aos detalhes de sua implementação-podem ajudar a garantir que essas tecnologias ofereçam mais benefícios que os encargos.

- As ferramentas de IA precisam fornecer um equilíbrio apropriado de informações aos usuários do clínico. Envolver médicos no projeto e desenvolvimento de ferramentas de apoio à decisão de IA podem levar a encontrar a zona “Goldilocks” dos níveis corretos de informações fornecidas pela ferramenta de IA.

Mais informações:

Yan Jia et al. arxiv (2025). Doi: 10.48550/arxiv.2503.18778

arxiv

Fornecido pela Universidade de York

Citação: O ônus percebido da IA dificulta a adoção da saúde, o estudo descobre (2025, 26 de março) recuperado em 26 de março de 2025 de https://medicalxpress.com/news/2025-03-ai-burden-hinders-health.html

Este documento está sujeito a direitos autorais. Além de qualquer negociação justa para fins de estudo ou pesquisa particular, nenhuma parte pode ser reproduzida sem a permissão por escrito. O conteúdo é fornecido apenas para fins de informação.