Ai enfrenta ceticismo nas decisões de fim de vida, com as pessoas favorecendo o julgamento humano

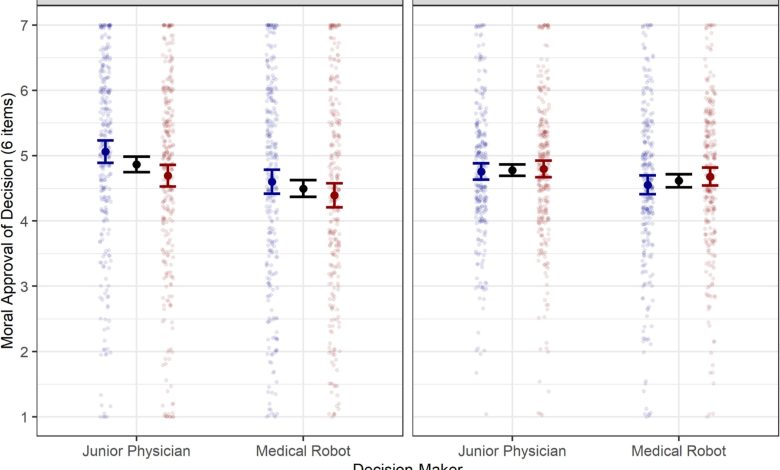

Na decisão de desligar o suporte da vida, há uma tendência linear clara, onde a aprovação moral é mais baixa no grupo avançado de IA-condição de robô médica e mais alta na condição de equipe humana-humana. Crédito: Cognição (2025). Doi: 10.1016/j.cognition.2025.106177

O papel da IA na tomada de decisões médicas provoca diferentes reações nas pessoas quando comparadas aos médicos humanos. Um novo estudo investigou as situações em que a aceitação difere e por que com histórias que descrevem casos médicos.

As pessoas aceitam as decisões de eutanásia tomadas por robôs e IA com menos frequência do que os tomados por médicos humanos, encontram um novo estudo. O estudo internacional, liderado pela Universidade de Turku, na Finlândia, investigou os julgamentos morais das pessoas sobre as decisões tomadas por IA e robôs, bem como os seres humanos sobre os cuidados no final da vida em relação às pessoas em coma.

A equipe de pesquisa conduziu o estudo na Finlândia, Tchechia e Grã -Bretanha, contando as histórias dos sujeitos da pesquisa que descrevem casos médicos. A pesquisa é publicada na revista Cognição.

O principal investigador do projeto, o professor da Universidade Michael Laakasuo, da Universidade de Turku, explica que o fenômeno onde as pessoas mantêm algumas das decisões tomadas pela IA e robôs a um padrão mais alto do que as decisões semelhantes tomadas por seres humanos é chamado de efeito de medimento moral humano -robot.

“No entanto, ainda é um mistério científico no qual surge decisões e situações o efeito de assimetria do julgamento moral. Nossa equipe estudou vários fatores situacionais relacionados ao surgimento desse fenômeno e à aceitação das decisões morais”, diz Laakasuo.

Os seres humanos são percebidos como tomadores de decisão mais competentes

De acordo com os resultados da pesquisa, o fenômeno onde as pessoas eram menos propensas a aceitar decisões de eutanásia tomadas por IA ou um robô do que por um médico humano ocorreu, independentemente de a máquina estar em um papel consultivo ou no tomador de decisão real.

Se a decisão era manter o sistema de apoio à vida, não houve assimetria de julgamento entre as decisões tomadas por humanos e IA. No entanto, em geral, os sujeitos da pesquisa preferiram as decisões em que o suporte à vida foi desligado em vez de ser mantido.

A diferença na aceitação entre os tomadores de decisão humana e de IA desapareceu em situações em que o paciente, na história contada aos sujeitos da pesquisa, estava acordado e solicitou a eutanásia, por exemplo, por injeção letal.

A equipe de pesquisa também descobriu que a assimetria de julgamento moral é pelo menos parcialmente causada pelas pessoas em relação à IA como tomadores de decisão menos competentes do que os humanos.

“A capacidade da IA de explicar e justificar suas decisões foi vista como limitada, o que pode ajudar a explicar por que as pessoas aceitam menos papéis clínicos”.

Experiências com IA desempenham um papel importante

Segundo Laakasuo, os resultados sugerem que a autonomia do paciente é fundamental quando se trata da aplicação da IA nos cuidados de saúde.

“Nossa pesquisa destaca a natureza complexa dos julgamentos morais ao considerar a tomada de decisões da IA em cuidados médicos. As pessoas percebem o envolvimento da IA na tomada de decisões de maneira muito diferente em comparação com quando um humano está responsável”, diz ele.

“As implicações desta pesquisa são significativas como o papel da IA em nossa sociedade e os cuidados médicos se expandem todos os dias. É importante entender as experiências e reações das pessoas comuns para que sistemas futuros possam ser percebidos como moralmente aceitáveis”.

Mais informações:

Michael Laakasuo et al. Cognição (2025). Doi: 10.1016/j.cognition.2025.106177

Fornecido pela Universidade de Turku

Citação: Ai enfrenta ceticismo nas decisões de final de vida, com as pessoas favorecendo o julgamento humano (2025, 27 de maio) recuperado em 27 de maio de 2025 de https://medicalxpress.com/news/2025-05-ai-skepticism-life-decisions-people.html

Este documento está sujeito a direitos autorais. Além de qualquer negociação justa para fins de estudo ou pesquisa particular, nenhuma parte pode ser reproduzida sem a permissão por escrito. O conteúdo é fornecido apenas para fins de informação.